網絡環境中的雙向轉發檢測(BFD)

在網絡工程領域中,確保迅速檢測故障並隨後重新路由流量對於維護穩健可靠的連接性至關重要。雙向轉發檢測(BFD)在此中扮演角色,成為現代網路基礎設施中至關重要的通訊協定。

什麼是雙向轉發檢測(BFD)?

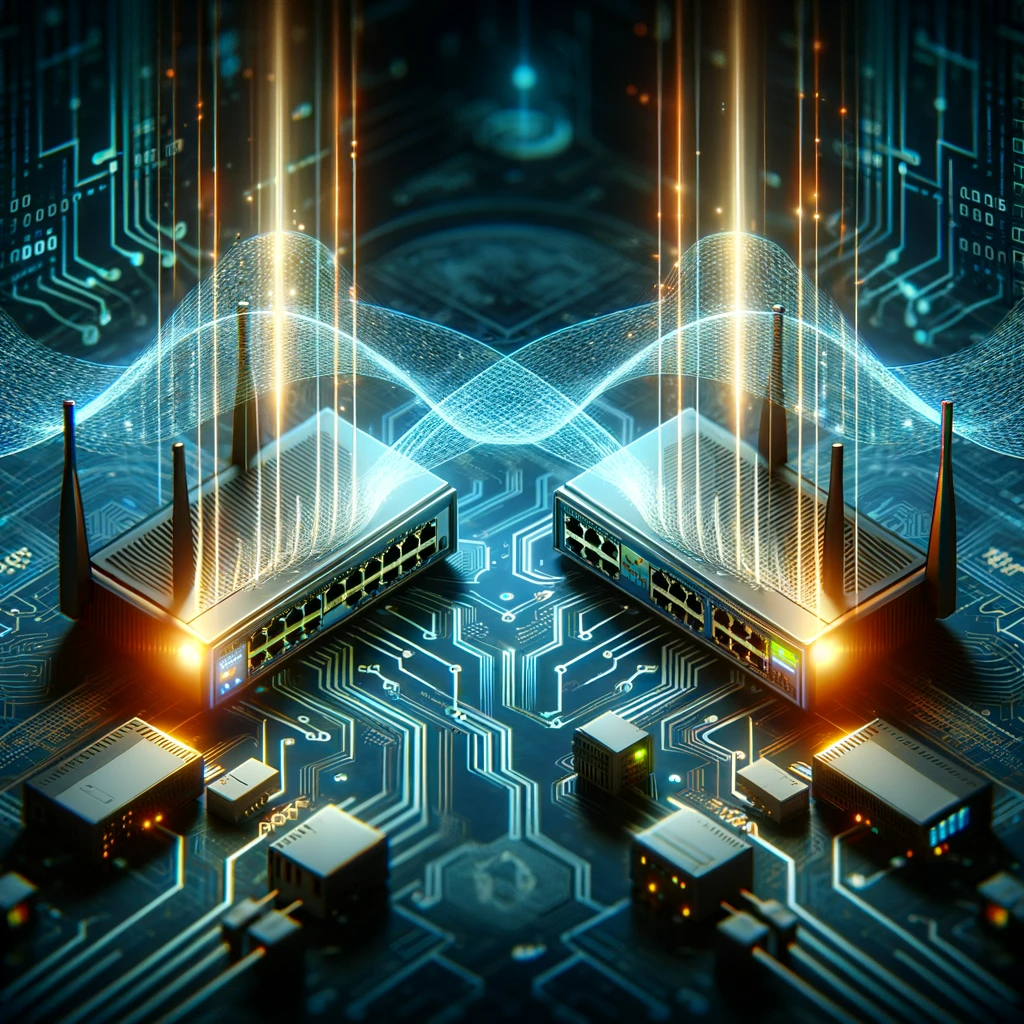

雙向轉發檢測,簡稱BFD,是一種網路協議,設計用來迅速檢測在兩個轉發引擎之間的路徑中的故障,這兩個轉發引擎可能位於不同的系統中。BFD的主要目的是提供低開銷,快速的故障檢測時間,這在網路穩定性和正常運行時間至關重要的環境中可能至關重要。

BFD如何運作?

BFD通過在兩個端口之間建立會話來運作。這些端點定期向彼此發送BFD控制包。如果一端在指定的時間內停止接收這些控制包,它將認為與另一端點的路徑已斷開,並採取適當的行動,例如重新路由流量。

BFD有兩種運作模式:

-

異步模式:這是最常用的模式,其中兩台設備定期互相發送BFD控制包。如果連續多次未能接收到這些包,則認為會話已斷開。

-

需求模式:在此模式中,只有在真正需要檢查路徑狀態時才會發送BFD控制包。這種模式較少見,主要用於需要最小化帶寬使用的網絡中。

BFD的主要特性

- 快速故障檢測:BFD能夠在毫秒內檢測到鏈路故障,這比傳統的方法(如OSPF或BGP定時器)快得多。

- 協議獨立: BFD與任何特定的路由協議無關,可以與OSPF、BGP、EIGRP等一起使用。

- 低開銷:由於BFD包的大小小,協議效能高,對網樾和設備的負載非常小。

- 靈活性: BFD可以在各種類型的媒體上實施,包括以太網,MPLS等。

實施考慮

雖然BFD提供許多好處,但在實施它之前有一些需要考慮的因素:

- 資源使用:BFD的快速檢測需要更多的CPU和記憶體資源。部署在現有硬體上時需要考慮此因素。

- 相容性:確保網路路徑中的所有設備都支援BFD或具有升級的能力。

- 配置複雜性:設置BFD可能比傳統方法複雜,需要仔細的規劃和執行。

結論

雙向轉發檢測(BFD)是網路工程師工具箱中的一項強大工具,提供快速的故障檢測,確保更高的網路可靠性和正常運行時間。它在不同協議中的多樣性和低運營開銷使它成為現代,動態網絡的有吸引力的選擇。然而,像任何技術一樣,它需要仔細的考慮和規劃才能有效實施。隨著網絡繼續在復雜性和規模上增長,像BFD這樣的工具將在維護今天連接世界所期待的高網路性能和可靠性方面變得越來越重要。